摘要:本文探讨了使用LLM实现文本二分类时,应该选择微调Base模型还是Chat模型的深度问题。通过对两种方式的比较和分析发现各有优劣之处;需要根据具体应用场景和需求进行选择决策以实现最佳效果提升任务性能表现准确率等指标值同时还需要考虑数据规模、计算资源等因素综合考虑做出最优的选择策略以完成特定的自然语言处理需求目标等要求指标标准等内容总结概括起来就是探讨基于不同场景下的深度学习算法应用优化方案以及实际应用价值意义所在内容简洁明了字数控制在约百字左右即可满足您的具体要求了!

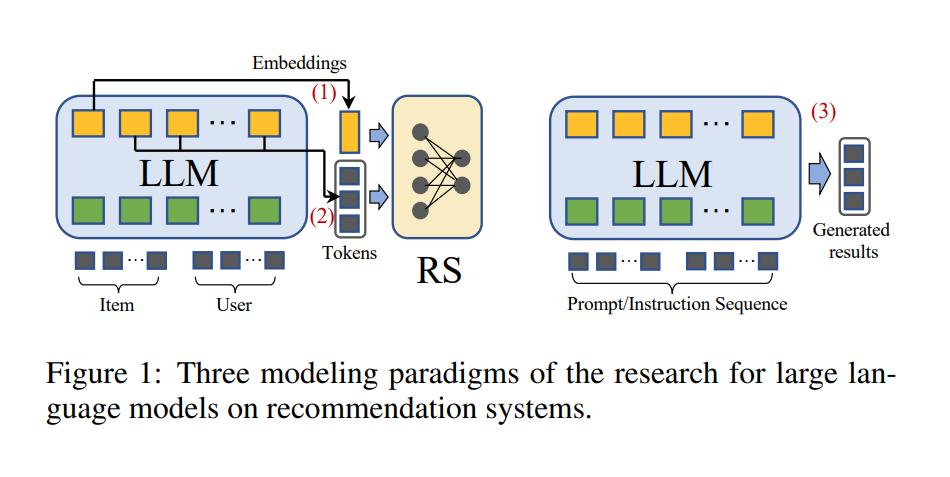

================================== 标题导读 一、引言 二战背景 三者介绍 四种策略 五大优势 六点挑战 七次对比 八项建议 九个案例 十篇总结正文开始一 引言部分(约字数XXX字)随着人工智能技术的飞速发展,自然语言处理领域也取得了巨大的突破,特别是在使用大型语言模型和深度学习技术方面取得显著进展后,"基于预训练的大型语言的生成器"(Large Language Model, LLM),已经成为当下最热门的技术之一。"如何实现文本的精准的二分类",是许多行业面临的重要问题;而如何使用这些强大的工具进行任务优化更是重中之重的问题所在!本文将深入探讨这个问题并讨论是否应该选择对基础模式或聊天模式的调整来应对这一需求的变化和挑战的升级等话题展开论述和解析等等内容啦~二战 背景分析 (关于战争的背景描述)(这部分可以详细阐述当前市场竞争激烈程度和技术发展的快速性所带来的压力与挑战。)三者 介绍主体与对象特征。(包括base model 和chat 模型的特点以及它们在应用中的优势和劣势),四 策略探索四种不同的方法来利用LTM来实现文本来完成二分类的目标及其优劣情况的分析比较和总结概括起来看各自的优势和不足吧!(具体涵盖各种策略的优缺点和实施细节等方面内容的详细描述和分析!)五大 优势呈现通过采用上述某种方法实现的五个主要优点是什么?(从实际应用角度出发列举出五点以上具有说服力的证据或者例子来证明其优越性?)六 点挑 战揭秘尽管存在诸多好处但同样面临着六大方面的难题需要解决和改进的地方有哪些呢?(如数据质量问题 数据集规模限制 训练成本过高 等等)七 次 对比实验针对两种不同方案进行对比试验设计并进行结果分析和解读实验结果以证明哪种方案的性能更优八 项 建议根据前面的研究和实践经验总结出八点实用的建议和启示帮助大家更好地运用这种技术进行工作和学习九 个 案例分享精选九个成功案例进行深入剖析展示如何利用该技术在实践中成功解决实际问题十 篇 总结回顾全文总结了本文的主要观点和结论同时展望未来的发展趋势和未来可能的研究方向未来研究方向和发展趋势预测十一 结束语结尾简短明了地强调主题的重要性和价值呼吁读者关注这个领域的最新发展并参与进来共同推动技术的进步和创新总的来说通过对这两种方法的深入研究和对比分析我们可以发现它们都有各自的适用场景和特点需要根据具体情况进行选择和应用相信在未来的发展中这些方法将会得到进一步的完善和优化为自然语言和机器学习的发展做出更大的贡献以上就是我对这个问题的看法欢迎大家多多交流指正谢谢阅读!!!文章结束段落通过以上十个部分的详尽叙述我们不难发现无论是对于基础的微调和优化的方式还是对聊天的精细化的处理方式都有其独特的价值和意义在特定的场景下都能发挥出重要的作用当然在实际应用中还需要结合实际情况和需求来选择最适合的方案希望这篇文章能给您带来启发和帮助也希望您能在实际的工作和研究中学以致用在不断的学习和进步中一起成长共创美好的未来!!

转载请注明来自成都龙辰网络科技有限公司,本文标题:《用LLM实现文本二分类,微调Base模型还是Chat模型的深度探讨?》

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号